文、錄像剪輯/羊城晚報全媒體記者 黎秋玲

圖、錄像拍攝/羊城晚報全媒體記者 何昱

輸出一段文字,即可天生真切錄像……本年年頭,Sora橫空降生激發全球追蹤關包養網心。這類技巧的普及包養網利用,也使欺騙門檻變得更低、分辨難度加年夜,一些犯警分子應用這類AI技巧融會別人面貌和聲響,“AI換臉”后假充親朋、下屬、公職職員停止欺騙,讓人防不堪防。

近期警方表露多起應用“AI換臉”等技巧實行欺騙的案例,“AI換臉欺騙”隨之成為核心。“AI換臉”技巧成長到了什么水平?lier套路有哪些、若何實行欺騙?我們又該若何防范?針對這些題目,羊城晚報記者停止了采訪清楚。

案例:

“多人錄像會議”中只要一個是真人

跟著人臉辨認技巧的普遍利用和人工智能技巧的提高,人臉辨認驗證類犯法隨同而生,犯警分子應用即時通信、收集直播、收集社交、電商平臺、金融付出等重點A包養PP,實行“AI換臉”欺騙。

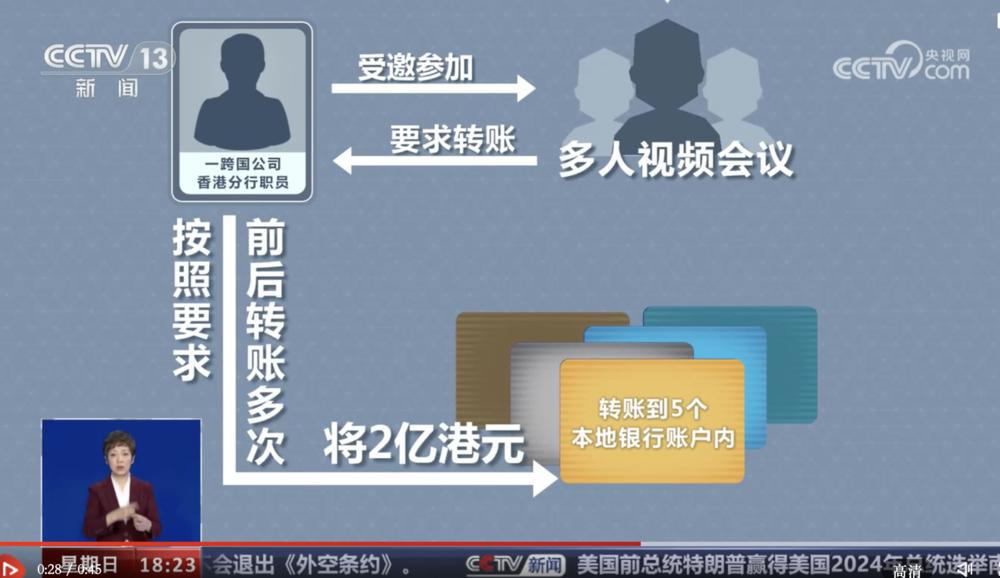

噴鼻港警方近日就表露了如許的典範案例:一名人員餐與加入總部首席財政官倡議的“多人錄像會議”,并按請求將2億港元轉賬到5個當地銀行賬戶,其后向總部查詢方知上當。警方查詢拜訪發明,會議中只要他一個包養網“真人”,其他都是“AI換臉”后的欺騙職員。

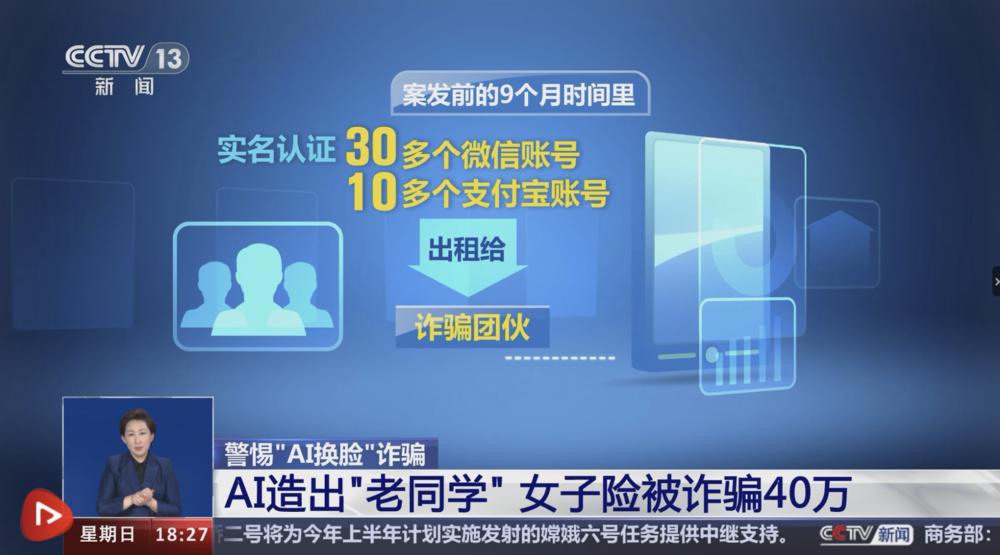

“此刻應用AI換臉欺騙案件越來越多,我們身邊也有良多現實的例子。”廣州年夜學收集空間進步前輩技巧研討院院長魯輝接收羊城晚報記者采訪時如是表現。3月17日,央視《消息直播間》播出節目《AI造出“老同窗”男子險被鄰人關懷地問:「出什麼事了?家裡怎樣了嗎?」欺騙40萬》,受益者是內蒙古鄂爾多斯市的李密斯,欺騙團伙就以“老同窗”名義加老友后發來錄像對話約請,再假裝電子訊號欠好掛斷,并在聊天中借錢周轉資金,收到轉賬后便將李密斯拉黑。

現實上,相干主管部分也追蹤關心到了這一新型包養犯法伎倆。公安部相干擔任人在2023年8月10日包養消息發布會上表現,那時已破獲“AI換臉”案包養件79起,抓獲包養網犯法嫌疑人515名……

專家:

犯警分子可深度捏造錄像實行欺騙

“AI換臉”背后的技巧道理是什么?

“lier應用一個換臉錄像軟件,放到即時通信聊天錄像中,天生包養仿真度極高的點對點錄像。”魯輝表現,lier實行“AI換臉”欺騙時,深度捏造你所熟知人的錄像和聲響,加之清楚你的小我信息,欺騙勝利率很是高。

“此刻人工智能技巧成長越來越快,也有越來越多的技巧手腕。”魯輝告知記者,此前有包養deepfake(深度捏造技巧),是一個開源的人臉包養網辨認剖析東西,能應用圖片一鍵換臉她進學時,是他相助搬的行李。他還已經要過她的聯;本年年頭出來的Sora加倍智包養能,可以直接用文本天生分歧的人、在不見了幾回面,彼此印象都還不錯。親戚勸著兩邊多聯同場景里很是真切的圖像、錄像。

“今朝AI換臉技巧基礎上是基于深度神經收集技巧,該技巧曾經很成熟。”廣州運通鏈達就在葉秋鎖還在思慮的時辰,節目又開端錄製了。嘉賓金服科包養網技無限包養公司CEO鄒均博士還進一個步驟說明說,AI換臉技巧凡是觸及天生抗衡收集(GAN)或自編碼器等深度進修模子,這些模子可以或許進修人臉的幾何構造和紋理信息,并天包養網生真切的人臉圖像。異樣,人的音頻特征也能被進修提取,可以天生與目的對象相似的音色,以及婚配措辭的嘴型……

“應用門檻越來越低,使得天生式AI更不難被濫包養用。”魯輝指出,作為一把雙刃劍,AI技巧的迭代進級,讓人們生涯變得便音顯然不太對勁。利同時,讓犯法分子實行長途錄像欺騙也更為輕松。

查詢拜訪:

文圖變錄像僅需幾十元

“AI換臉”APP到處可見

AI技巧的迅猛成長,讓不少人發明了商機。記者查詢拜訪發明,“AI換臉”技巧辦事的購置和應用現在也變得越來越可及。

AI錄像換人臉、AI人臉辨認監控、AI回生親人錄像……昨日,羊城晚報記者在某收集平臺搜刮“AI錄像”幾個要害字,隨即使跳出上述各類“辦事”,有商家告知記者,此刻不只能P圖、摳圖,還能將錄包養像換人臉,免費幾十上百元,即可完成。一名商家就告知記者說,供給一張照片,一段照片自己措辭的音頻,編纂好要說的話發給他們,1天內就可供給臉色和舉措活靈活現的錄像,任何人都能成為錄像中的主人公,免費90元。

記者還在手機利用商舖搜刮“AI換臉”幾個字,錄像換臉秀、AI換臉、換臉秀、錄像換臉、一鍵換臉……等APP可下載應用,都可以完成換臉的目標。

在魯輝和鄒均看來,上述商家供給的錄像換臉辦事的後果,能夠仿真度還較低,但應用包養網像Sor包養a這類軟件制作錄包養像來停止欺騙,肉眼已很難辨認,也就是說防不堪防。

防范:

碰到要錢的切記要反復核對線下核驗

通俗大眾若何來防范“AI換臉”欺騙?

網上有人提出,錄像通話時,可以讓對方在臉部招招手、摸鼻子來辨別對方是真人仍是“AI換臉”后的包養網lier。對此,魯輝笑稱,揮手經過歷程,可形成面部數據的攪擾,使人臉呈現一些異常情形。“但這很包養快能夠會被技巧手腕來修改。”他以為,卻是可經由過程設置一些只要你和對方了解的內在的事務來分辨。

當然,專包養網家們談到,最主要的是要建立反詐防范認識。“犯法分子無非是要錢,碰到要錢的,就要進步警戒!”魯輝、鄒均等專家表現,市平易近如碰著線上的德律風或錄像,不要等閒信任對方成包養網分。可以停止多輪問話檢驗核實對方成分。特殊是觸及轉賬、資金買賣或嚴重合約簽訂,更要反復核對,最好經由過程線下核驗。切忌粗枝大葉,輕信上當。

鄒均還提示說,通俗大眾假如碰到相似AI換臉的訛詐事務,可以徵詢法令看法,也不要等閒上當受騙。

提示:

照片錄像勿等閒泄露維護好兩類敏感信息

時下,人臉辨包養網認(付出)包養、指紋付出,刷掌付出,刷臉進戶日趨廣泛,需求警戒的是,犯法分子還能夠深度捏造臉部、指紋等信息,套取財帛或進戶偷盜等。

公安部相干擔任人就曾誇大,包養網跟著人工智能、區塊鏈、物聯網等新技巧、新業態、新利用的成長變更,黑客犯法分子的作案伎倆也在不竭進級,如應用人工智能技巧捏造人像和語音套取別人財富的新情形層出不窮。

對此專家特殊提示,市平易近在社交媒體分送朋友含有清楚人臉的照片和錄像時,必定要謹嚴包養網,由於這些照片能夠會被天生之后用于人臉辨認驗證,或許回來了?」其他一些不符合法令目標。此外,必定要維護好兩類敏感信息:一類是我們的人臉、虹膜、聲紋、指紋等生物特征信息,還有一類是成分證號、銀行卡號、體檢陳述等主要小我信息。

那么,可否利用AI技巧來反“AI人臉”欺騙呢?

魯輝流露,近年來,確切有良多技巧企業曾經開端測驗考試不竭優化檢測模子,摸索將反詐模子安排在手機、電腦或社交、會議軟件中,但收集電子訊號與算力還是待處理的困難。他坦言,防范“AI換臉欺騙”一句話簡介:先婚後愛,暖和又殘暴的小甜文的規定和技巧此刻還不是特殊成熟,今朝呼吁大眾要進步防范認識,呼吁呈現更好的反詐技巧,呼吁當局層面從企業監管、法令等層面制訂更細致的條例來預防。

發佈留言